Hace unos días ha aparecido por Internet un vídeo que se ha convertido en viral, donde una persona hace una prueba que intenta demostrar cómo algunas empresas (supuestamente) nos vigilan desde Internet.

Hace unos días ha aparecido por Internet un vídeo que se ha convertido en viral, donde una persona hace una prueba que intenta demostrar cómo algunas empresas (supuestamente) nos vigilan desde Internet.

En dicho video, este usuario pone el foco en concreto en Google y si nos escucha a través del ordenador, aunque no tengamos activado el asistente de audio (el icono en forma de micrófono que aparece a la derecha de la barra del buscador Google) o su asistente Google Home.

Para ello muestra en pantalla un tema (en este caso juguetes para perros) y comprueba en varias páginas que los anuncios de AdSense no aparece nada relacionado con lo que ha mostrado en pantalla. En mitad del video pronuncia en voz alta el tema de los juguetes de perros, y de repente aparecen varios anuncios relacionados con este tema.

Aquí podéis ver la prueba al completo:

La verdad es que el mensaje que lanza el video es muy preocupante, pero le falta un poco de rigurosidad. No se muestran en ningún momento pruebas digamos más técnicas, como por ejemplo una aplicación que sea capaz de analizar la información transmitida por el micrófono, un análisis de paquetes o cualquier otra que demuestre realmente que dicha escucha se ha realizado sin consentimiento del usuario.

Es posible que incluso esta persona hiciera dicha búsqueda en otro dispositivo (por ejemplo, un smartphone) utilizando su cuenta de Google y por lo tanto se replicara en todos los dispositivos asociados a él. De todas formas, al menos reabre un viejo debate que comenzó con el uso no autorizado de las cámaras web (webcams) y que ahora también se traslada al micrófono (aunque realmente siempre ha estado ahí, al ser este un dispositivo integrado también en las cámaras web). Y ya tuvimos un escándalo similar con las SmartTVs de Samsung que estuvieron en el ojo del huracán por ser demasiado explícitos en sus Terms & Conditions.

El tema de las escuchas por parte de estas empresas para luego ofrecerte anuncios a medida no es algo nuevo, y debido a los Cognitive Services para el Procesamiento Natural del Lenguaje de las plataformas de Artificial Intelligence de los grandes proveedores de Cloud, es algo más que posible en el mundo en el que estamos.

| Figura 3: Ads, Ads, Ads |

En la red hay muchas personas que corroboran este hecho, pero ninguna tiene una prueba sólida. Es más, el beneficio que puede obtener una empresa realizando este tipo de escucha y proyectando los resultados sólo para dirigir publicidad no son rentables comparados a una posible denuncia y mala imagen en caso de ser ciertas. Más bien podría ser un efecto de una teoría donde se afirma que las personas podrían estar afectadas por el fenómeno Baader-Meinhof. Pero este tipo de vídeos siguen apareciendo una y otra vez.

Hace sólo unos meses, otro usuario realizó una prueba parecida, esta vez desde un smartphone y utilizando la app de Facebook. En el siguiente vídeo podéis verla, pero de nuevo, tenemos que confiar en la palabra del usuario ya que no existen pruebas fiables:

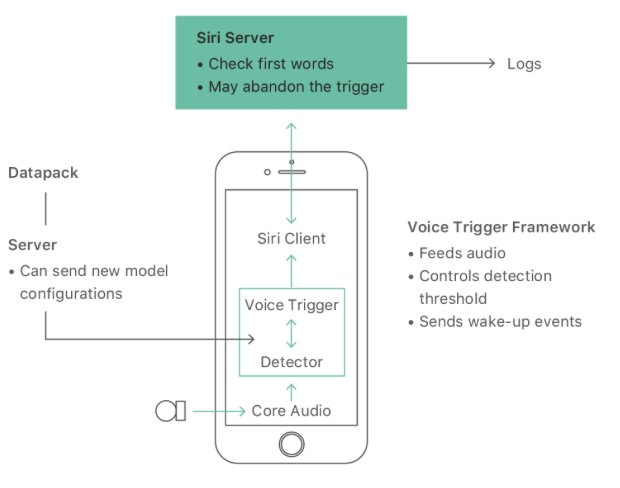

Esto no quiere decir que estas compañías las cuales ofrecen asistentes digitales como Cortana, Google Home, Alexa o Siri (Microsoft, Google, Amazon y Apple respectivamente) no graben lo que decimos y almacenen las conversaciones en sus servidores. De hecho, esto necesario para luego procesar y analizar las peticiones realizadas. En muchas empresas, los servicios de Siri fueron cortados para evitar los datos a los servidores de Apple, ya que los servicios de Procesamiento Natural del Lenguaje se produce en sus servidores.

Eso sí, sólo deberían funcionar cuando el usuario quiera activarlos, tanto desde la pantalla usando el icono de un micrófono (como es el caso de Google) o desde voz indicando alguna frase de activación como “Ok Google” o el famoso «Oye Siri» y luego se debería de borrar la información pasado un corto periodo de tiempo. Hay que destacar que el micrófono tiene que estar activado en el dispositivo todo el tiempo para poder registrar estas órdenes de activación o “despertar”, pero según ellos, esta información llamémosla “ambiental” no se procesa ni se envía, como veremos más adelante. En SeguridadApple puedes encontrar este artículo donde se habla sobre qué ocurre con esta información, en este caso Siri de Apple.

Es muy difícil, por no decir imposible, saber exactamente qué información envían estos dispositivos a sus servidores centrales. Sólo podemos realizar algún tipo de suposición basándonos en algunos análisis superficiales de los paquetes enviados. Por ejemplo, en el caso de Amazon y su Amazon Echo, este utiliza cifrado TLS1.2 con validación/pinning de certificado, haciendo muy complicado realizar un ataque man-in-the-middle.

Toda la información digamos “sensible” se envía totalmente cifrada, lo que es un arma de doble filo porque por un lado es lógico para que en caso de interceptar tu red nadie pueda ver la información, pero por otro lado no sabemos qué información se está enviando.

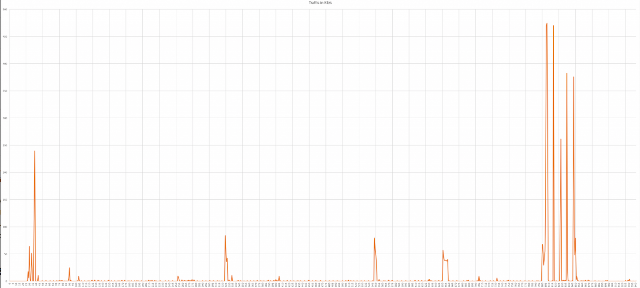

En el siguiente análisis de este mismo dispositivo de Amazon (con su asistente Alexa), se demuestra al menos que durante los periodos de silencio no se envía ninguna información al exterior. Para probarlo se ha monitorizado la ejecución de la siguiente secuencia de órdenes:

1. 8 segundos de silencio (sonido ambiental)

2. Pregunta “Alexa, ¿qué hora es?” y respuesta en 6 segundos

3. 8 segundos de silencio

4. Pregunta “Alexa, té earl gray, caliente” y respuesta en 5 segundos

5. 23 segundos de una conversación normal entre dos personas (evitando palabras que pudieran activar Alexa)

En la gráfica siguiente se puede comprobar que durante los periodos de sonido ambiental o de conversación sin interacción con Alexa, no se recopilan datos al menos por la red. Tampoco sabemos realmente si existe algún tipo de grabación interno en el dispositivo desde el cual se almacena primero la información y luego se envía cifrada u oculta con esteganografía (este sería otro punto que analizar, pero el código de estos dispositivos no es OpenSource):

En este otro análisis muy parecido pero esta vez con Google Home se llega a la misma conclusión. Estas son las pruebas realizadas:

• 0-40 segundos, el equipo se reinicia

• 320 segundos, “Ok Google. What´s the weather? más respuesta

• 400 segundos, el micrófono se desactiva desde el dispositivo

• 400 – 500 segundos. Se intenta despertar el dispositivo con “Ok Google”

• 500 se vuelve a activar el micrófono

• 550 segundos, “Ok Google, ¿lloverá mañana?” más respuesta

• 650 segundos, “Ok Google…” comando de activación sin respuesta

• 800 segundos, “Ok Google, pon algo de música” y se ejecuta Spotify

• 850 segundos, “Ok Google. Es suficiente” y Spotify se detiene

Aquí podemos ver la gráfica obtenida donde observamos que durante los periodos de silencio no se envía ninguna información:

Pero claro, estos análisis hablan de asistentes digitales que necesitan del micrófono para poder interactuar con el usuario. ¿Más preocupado? ¿Más tranquilo? No te preocupes, en la siguiente parte tendrás más para pensar sobre este asunto.

Autor: Fran Ramiíez, (@cyberhadesblog) miembro del equipo de Crazy Ideas en CDO en Telefónica, autor del libro «Microhistorias: Anécdotas y Curiosidades de la historia de la informática (y los hackers)«, y del blog Cyberhades.

Fuente: http://www.elladodelmal.com/2018/04/nos-escuchan-por-los-microfonos-google.html

Visitas: 21